Dify(ディフィー)という名前は耳にしたものの、「結局Difyで何ができるのか」がいまひとつイメージできない方も多いですよね。

Difyはチャットボット・社内ナレッジ検索・業務自動化ワークフロー・AIエージェントといった生成AIアプリを、ノーコードまたはローコードで素早く構築できるプラットフォームです。プログラミング知識がなくても、ドラッグ&ドロップ感覚でAIアプリを作れます。

本記事では、Difyで具体的に作れるAIアプリの種類、主要な機能、活用事例、できないこと、ChatGPTやn8nなど他ツールとの違い、セルフホストでの動かし方までを整理して解説します。最後に、Difyを最短で動かしたい方向けにXServer VPSでのDifyインストール方法も紹介します。

そもそもDifyとは?まず押さえておきたい基本

Difyは、大規模言語モデル(LLM)を使ったAIアプリを、ノーコードで構築・運用できるオープンソースのプラットフォームです。

OpenAIのChatGPT、AnthropicのClaude、GoogleのGeminiなど、さまざまなLLMをひとつの画面から切り替えて呼び出せます。

チャットボットや社内ドキュメント検索、ワークフロー自動化といった「LLMを業務に組み込んだ仕組み」を、エンジニアでなくても作れるのがDifyの立ち位置です。

クラウド版(Dify Cloud)と、自分のサーバーに導入するセルフホスト版の2系統があり、用途や予算に合わせて使い分けられます。

ノーコード/ローコードでLLMアプリが作れる仕組み

Difyの本質は、「プロンプト」「外部データ」「LLM」「外部ツール」をブロック単位でつなぐビジュアルエディタです。

たとえば「ユーザーから質問が来たら、社内のFAQドキュメントを参照して回答する」AIチャットボットは、コードを書かずにブロックを並べるだけで作れます。簡単なものなら数分から数十分、本格的なものでも数日で形になるイメージです。

もちろんローコード寄りに踏み込み、APIから呼び出したり、独自プラグインを差し込んだりも可能です。ノーコードの手軽さと、エンジニア向けの拡張性の両方を持っているのが強みです。

開発元と運営状況

DifyはLangGenius社(中国・米国に拠点)が開発・運営するオープンソースプロジェクトで、GitHubでのスター数が多いLLMアプリ基盤のひとつとして知られています。

2026年に入ってからも資金調達や機能追加のニュースが続いており、開発スピードが落ちていない点は実用ツールを選ぶうえでの安心材料です。日本国内でも、価格.comの運営会社(カカクコム)がDify Enterpriseを採用するなど、エンタープライズ用途での利用実績が増えています。

Difyで何ができる?作れるAIアプリ5種類

Difyで作れるAIアプリは多岐にわたりますが、整理すると以下の5タイプに分類できます。

- チャットボット・AIアシスタント

- 社内ナレッジを参照するRAG型チャットボット

- 業務を自動化するAIワークフロー

- 複数ツールを使い分けるAIエージェント

- 要約・翻訳・分類などのテキスト処理ツール

チャットボット・AIアシスタント

もっとも基本的な使い方が、WebサイトやSlackに組み込めるチャットボット・AIアシスタントの構築です。

システムプロンプト(AIの役割設定)と利用するLLMを選ぶだけで、最低限のチャットボットなら数分で形になります。商品問い合わせ窓口、社内ヘルプデスク、自社サービスのカスタマーサポート補助などに使われています。

埋め込み用のスクリプトやAPIも提供されているため、既存のWordPressサイトに「サイト案内チャット」を載せるような用途にも向いています。

社内ナレッジを参照するRAG型チャットボット

Difyの真価が出るのが、独自ナレッジを参照して回答するチャットボットです。一般にRAG(Retrieval-Augmented Generation)と呼ばれる仕組みを使います。

RAGは、ChatGPTのような汎用LLMに「自社の社内文書」「マニュアル」「商品データベース」などの独自ナレッジを与え、それを根拠に回答させる仕組みです。Difyにはナレッジベース機能が標準搭載されており、PDF・Word・Notion・スプレッドシートなどを取り込むだけでRAGが構築できます。

「社内マニュアルを学習したチャットボット」「製品仕様書を検索できる営業支援AI」など、汎用LLMでは答えられない情報を扱える点が大きなメリットです。

業務を自動化するAIワークフロー

Difyのワークフロー機能を使えば、「決まった条件で動くAIの仕事」を組めるようになります。

たとえば、以下のような業務自動化が代表的です。

- 問い合わせメールの内容をAIが分類し、担当部署に自動で振り分ける

- 毎朝、ニュースサイトを巡回して要点をSlackに投稿する

- 営業日報を受け取り、要約と次のアクション提案を返す

- 請求書PDFから金額を抽出し、会計システム向けのCSVを生成する

ワークフローの起点には、スケジュール起動・Webhook(外部サービスからの通知受信)・プラグイン連携の3種類のトリガーが用意されており、定期実行と外部システム連携の両方に対応できます。

複数ツールを使い分けるAIエージェント

もう一段進んだ使い方が、AIエージェントの構築です。

AIエージェントは、ユーザーから受け取った曖昧な指示に対して、Webサイトの検索・社内DBの参照・計算・メール送信などのツールを自分で選んで組み合わせ、目的を達成しようとするAIです。Difyでは「ツール」と呼ばれる外部API連携機能を組み合わせることで、こうした自律的なAIをノーコードで作れます。

ただし、AIエージェントは便利な反面、権限を与えすぎると意図しない操作をしてしまうリスクがあります。Difyには、ワークフロー実行を一時停止して人間にレビュー・承認を依頼できる「Human Input Node」も用意されており、こうした人間判断との組み合わせで安全性を高められます。

要約・翻訳・分類などのテキスト処理ツール

「対話」を伴わない、裏方のテキスト処理ツールもDifyで作れます。

記事の要約、議事録の整形、英文メールの翻訳、レビュー文章のポジネガ分類、商品説明文の自動生成など、ChatGPTで「いつも同じプロンプトを貼っている」ような作業はワークフロー化することで、APIから呼び出せる定型ツールに変えられます。

これらは画面のあるアプリにする必要はなく、社内システムや既存のWordPressサイトからAPI経由で叩くだけで動かせるため、エンジニア視点でも組み込みやすいのが利点です。

Difyを支える主な機能

「何が作れるか」の裏側にある、Difyの主要機能を整理しておきます。

- マルチLLM対応

- ナレッジベース(RAG)

- ワークフロー&トリガー

- Human Input Node

- テンプレート・マーケットプレイス

- ログ・監視・チーム管理

マルチLLM対応で複数モデルを使い分けられる

Difyの中核機能のひとつが、OpenAI・Anthropic Claude・Google Gemini・xAI GrokなどのLLMを1つの画面から切り替えて使える点です。

「日常会話はGPT-4o系で安く回し、難しい推論はClaudeで解かせる」「画像理解はGeminiに任せる」のように、用途ごとに最適なLLMを選ぶ運用が可能になります。

Dify Cloud版では、初回サインアップ時に複数モデルの試用クレジットも付与されるため、APIキーをまだ持っていない方でも比較検証から始められます。

ナレッジベースで独自データを参照させられる

ナレッジベース機能は、独自ドキュメントをアップロードするだけでRAGアプリの基盤が整う仕組みです。

PDF・Word・Markdown・スプレッドシートなどに加え、近年では画像・テーブルなどを含むマルチモーダルなデータもナレッジに取り込めるよう機能拡張が進んでいます。社内文書だけでなく、製品マニュアル付属の図面や写真も検索対象にできるイメージです。

ワークフローの使い分け(3種類のトリガー)

前述のとおり、Difyのワークフローはスケジュール・Webhook・プラグインの3つから起動できます。実務では以下のように使い分けます。

- スケジュール:毎朝決まった時間に回したい定型業務(ニュース要約・日次レポート生成)

- Webhook:問い合わせフォームや決済イベントなど、外部サービスから来る通知の処理

- プラグイン:Slack・LINE・特定SaaSと深く連携したいときの専用入口

VPSにDifyを置けば、別途cronを書かなくてもサーバー側で自動的にワークフローが回るのは、副業エンジニアにも嬉しいポイントです。

Human Input Nodeで「人間承認」を組み込める

Human Input Nodeは、ワークフローの途中で人間の判断を挟める機能です。

たとえば「AIが下書きした回答をマネージャーが承認したら送信する」「外部に発信するメール内容は人間が最終チェックする」といった業務フローを、別システムを組まずDify内で完結できます。

AIエージェントの誤動作リスクを抑えたい用途では、ほぼ必須のパーツになります。

テンプレート・マーケットプレイス

Difyには、あらかじめ用意されたAIアプリのテンプレートが数多く揃っています。

SNS投稿文の生成、ブログ記事のアウトライン作成、コードレビュー、SQL生成、議事録要約など、よくあるユースケース向けの設計が公開されており、テンプレートをコピーして自社用にカスタマイズするのが最短ルートです。

2026年からはコミュニティが投稿した独自テンプレートを共有できるマーケットプレイス機能も拡充されており、ゼロから作る必要性はますます下がっています。

ログ・監視・チーム管理

業務利用で見落とされがちですが、実行ログ・トークン使用量・チームメンバー管理などの運用機能も備わっています。

「どのアプリにどれだけAPIコストがかかっているか」「誰がどんなプロンプトで使っているか」を後から追えるため、本番運用や法人利用での監査・コスト管理にも耐えられる設計です。

Difyの活用事例:実際にどう使われているか

Difyが実際にどう使われているのか、公開されている事例から代表的なものを紹介します。

価格.comでの全社的なAI開発基盤として

国内事例として象徴的なのが、価格.comを運営するカカクコムのDify Enterprise導入です。

Dify公式ブログの導入事例によれば、複数チーム向けに独立したAI開発環境を用意し、SSO(シングルサインオン)で安全に利用できるよう構築。商品データ抽出システムを3時間以内で本番化するなど、開発スピードの向上が報告されています。従業員の約75%がDifyを利用し、社内で約950のアプリケーションが運用されているとのこと。

「Difyは企業の基幹業務でも使えるのか」という不安に対する、わかりやすい回答事例です。

財務・経理処理の自動化

Dify公式ブログでは、仕訳処理を自動化した財務オートメーション事例も公開されています。

従来3〜5分かかっていた仕訳処理を5秒以下に短縮し、人間が確認しなければならない件数も全体の約15%程度まで削減できたとのこと。「AIで全自動化」ではなく「AI+人間の最終チェック」でも、業務効率は十分大きく改善することを示す事例です。

問い合わせメールの意図分類と振り分け

もうひとつ典型的なのが、メールの意図をAIが認識して、適切な担当部署や個人に自動で振り分けるワークフローです。

Difyのワークフロー機能とLLMの言語理解力を組み合わせれば、「契約相談」「不具合報告」「請求書関連」などのカテゴリを高精度で判定し、Slack通知やメール転送に自動でつなげられます。問い合わせ窓口を1本化したい中小企業や、サポートチームの工数を圧縮したい現場と相性が良い用途です。

Difyでできないこと・向いていない用途

Difyは万能ではありません。得意分野と苦手分野を理解しておかないと、導入してから「思っていたのと違う」になりがちです。

- LLMモデルそのものの精度を超える出力

- 独自モデルの大規模なファインチューニング

- ミリ秒単位のリアルタイム処理

- 完全オフライン環境・閉域網のみで動かしたい場合

LLMモデル自体の精度を超える出力はできない

DifyはあくまでLLMを呼び出して使うガワです。

呼び出すLLMがChatGPTやClaudeであれば、Difyを通しても出力品質はそのLLMの実力以上にはなりません。「Difyに変えれば精度が劇的に上がる」と期待しすぎず、プロンプト設計・参照ナレッジの整備・モデル選定がそのまま品質を左右する点は意識しておきたいところです。

独自モデルの大規模ファインチューニングには向かない

Difyは既存のLLMを束ねるプラットフォームであり、自社データで独自モデルを一から学習させたり、大規模なファインチューニングを回したりするための環境ではありません。

独自モデル開発が目的の場合は、PyTorchやHugging FaceのTransformersといったフレームワークと、GPUサーバーやクラウドGPU環境を別途用意する必要があります。Difyはその後段で「学習済みモデルを業務に組み込む」役割を担うイメージです。

ミリ秒単位のリアルタイム処理には向かない

LLMの推論には数百ミリ秒〜数秒かかります。Difyを経由するとその上にネットワーク・認証・ワークフロー処理が乗るため、ミリ秒単位の応答が求められるシステムには向きません。

ゲーム内のNPC即応・高頻度トレードのリアルタイム判定・組み込み機器のセンサー応答などは、別の技術スタックを検討した方が無難です。

完全オフライン環境では工夫が必要

クラウド版のDifyはインターネット接続が前提ですし、セルフホストでもOpenAI等の外部LLMを使うならインターネット経由のAPI通信が発生します。

完全に閉域網のみで運用したい場合は、Difyをセルフホストしたうえで、ローカルLLM(Llama・Qwen・Mistralなどのオープンモデル)と組み合わせる構成が必要です。実現は可能ですが、GPUサーバーや運用ノウハウが求められるため、難易度は一段上がります。

DifyとChatGPT・他ツールの違い

「ChatGPTで十分では?」「n8nやLangChainと何が違うの?」という疑問は多くの方が持つ部分です。立ち位置を整理しておきます。

| ツール | 立ち位置 | 得意領域 | Difyとの違い |

|---|---|---|---|

| ChatGPT(GPTs) | OpenAI公式の対話+カスタムGPTビルダー | 個人利用、簡単なチャット | OpenAIモデル中心。ナレッジ管理や複数モデル切替、ワークフローはDifyに分がある |

| n8n/Zapier/Make | 業務自動化・iPaaS | SaaS同士のAPI連携・タスク自動化 | LLMアプリの構築・ナレッジRAGはDifyの方が得意。逆にSaaS連携の網羅性ではn8n・Zapierが強い |

| LangChain/LlamaIndex | LLMアプリ構築用ライブラリ | コードで自由度の高い実装 | コーディング前提。ノーコード/GUI運用はDifyに分がある |

| Dify | ノーコードLLMアプリ基盤 | RAG・ワークフロー・エージェントを画面で構築 | — |

ChatGPT(GPTs)との違い

ChatGPTのGPTs機能は、OpenAIモデルに特化したカスタムチャットボットです。気軽に作れる反面、利用できるモデルがOpenAI製に限られ、業務用のログ管理やチーム機能、外部システム連携の自由度ではDifyの方が広いです。

詳しい人

詳しい人個人で使う簡単な秘書AIならChatGPTで十分。法人での業務利用や複数LLMの使い分けが必要ならDifyが向きます。

n8n・Zapierとの違い

n8nやZapierはSaaS同士をAPIでつなぐ業務自動化ツールです。「Gmailに新着が来たらSlackに通知してスプレッドシートに記録」のような、AI抜きの定型処理はこれらが本領を発揮します。

一方のDifyは「LLMをワークフローの中心に置く」前提の設計です。AIによる文章生成・分類・要約を業務フローの中心に据えたい場合はDifyが、外部SaaSの数珠つなぎが主役ならn8n・Zapierが、それぞれ強みを発揮します。両者を併用するケースも珍しくありません。

LangChain・LlamaIndexとの違い

LangChainやLlamaIndexはエンジニア向けのLLMアプリ構築ライブラリです。Pythonでコードを書いて自由に実装できますが、その分プログラミングスキルと運用基盤の整備が必要になります。

Difyは、こうしたライブラリ群をGUIで束ねたような立ち位置です。「LangChainで作るような仕組みを、画面操作で組みたい」のがDifyと捉えるとイメージしやすいでしょう。

Difyの始め方:クラウド版とセルフホスト版どちらを選ぶか

Difyの始め方は大きく3つに分かれます。

- クラウド版(Dify Cloud)にサインアップして使う

- VPSにセルフホストして自分のサーバーで動かす

- オンプレ・GPUサーバーで本格運用する

手早く試したいならクラウド版(Dify Cloud)

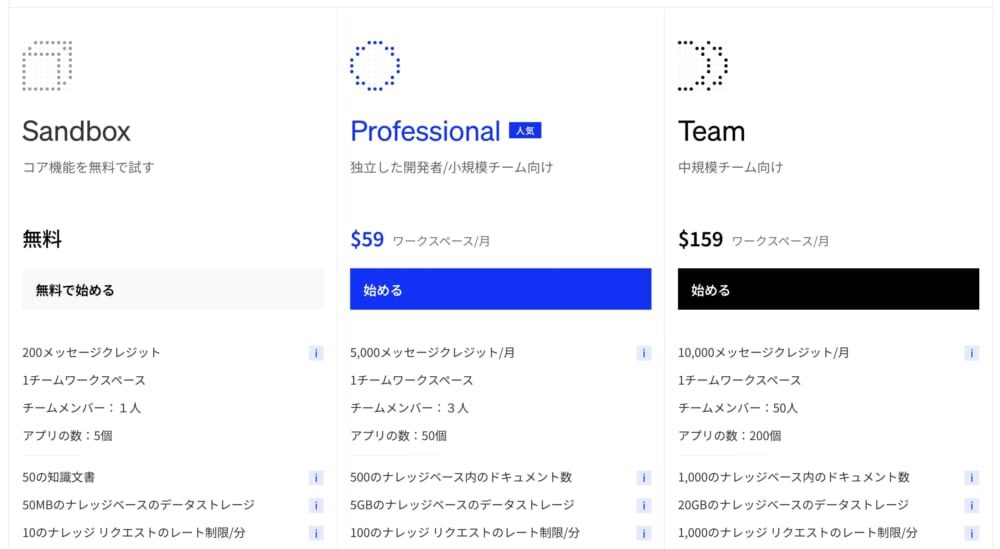

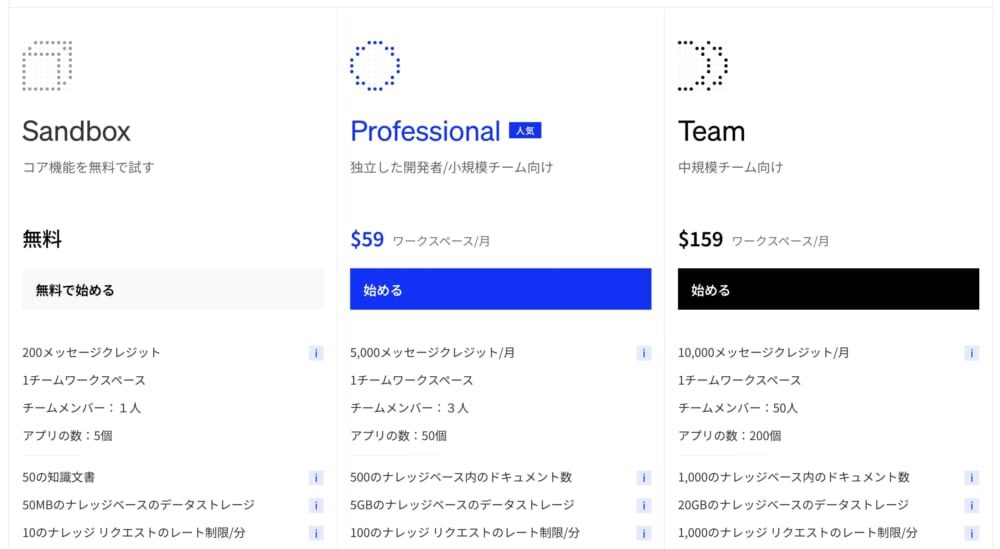

とりあえず触ってみたい段階なら、Dify Cloudの無料プラン(Sandbox)から始めるのが最短です。

サインアップだけで利用でき、OpenAI・Claude・Geminiなどの試用クレジットも付与されます。商用本格利用ではProfessionalプラン(公式サイトで月額数十ドル前後)以上にアップグレードする流れになりますが、検証目的なら無料枠でも十分手応えはつかめます。最新の料金は公式サイトで確認してください。

注意点としては、業務データを扱う場合、データの取り扱い・保管場所が気になる場合がある点です。社内の機密情報や顧客データを扱うなら、次のセルフホスト版を検討する方が無難です。

データ管理を握りたいならVPSにセルフホスト

本格的に業務で使うなら、VPSにセルフホストして自分の環境でDifyを動かすのが現実的な選択です。

セルフホストのメリットは以下のとおりです。

- 会話ログ・ナレッジデータを自社管理下に置ける

- 独自ドメインで運用できる

- クラウド版のサブスクリプション料金(月数十ドル〜)と比較してコストを抑えやすい

- 社内ネットワーク・既存システムとの連携をコントロールしやすい

必要スペックは、最低でもvCPU 4コア/メモリ6GB以上が目安です。Dify本体はAPI・Worker・ベクトルDB・Redisなど複数のコンテナで構成されるため、6GBはギリギリの最低ライン。長く使うなら、メモリ8〜12GB程度を確保しておくと安心です。

とくに「XServer VPS」のような、Difyのアプリイメージがあらかじめ用意されているサービスを利用するのがオススメです。

大規模運用や独自LLMを動かすならオンプレ・GPUサーバー

規模が大きくなったり、ローカルLLMを自前で動かしたい場合は、GPU搭載のオンプレサーバーやクラウドGPUと組み合わせる構成も選択肢に入ります。

Dify公式でも、NVIDIA DGX Sparkのような高性能オンプレGPU上でDifyとローカルLLMを組み合わせ、プライベートなAIエージェントを動かす構成例が紹介されています。機密性の高い業界(医療・金融など)で「データを社外に出さずAIを使う」場合に有力な選択肢です。

ただし、初期コストも運用負荷も高くなるため、いきなりこのレベルから始める必要はありません。まずはクラウド版かVPSセルフホストで小さく検証するのが定石です。

【注意】Difyを使い始める前に知っておきたいこと

導入前に、以下の3点は押さえておきましょう。

- LLMのAPIコストは別途発生する

- セルフホスト版はバージョンアップ運用が必要

- 業務データの扱いはホスティング先次第で変わる

LLMのAPI料金は別建てで発生する

Difyのクラウド版のサブスク料金、もしくはセルフホストのVPS料金とは別に、OpenAI・Anthropic・GoogleなどのLLM API料金がかかります。

個人がチャットボット1本を試す程度ならGPT-4o miniやClaude Haiku系の安価モデルで月数百円〜に収まる感覚です。一方、社内RAGを毎日数百件叩いたり、Claude Sonnet・GPT-4oクラスの高性能モデルを多用すると、月数千円〜数万円のAPI料金に膨らむこともあります。最初に「どのモデルでいくらくらい使うか」を試算しておくと安心です。

セルフホスト版はバージョンアップ運用が必要

Difyはアクティブな開発が続いているプロダクトで、セキュリティ修正を含むバージョンアップが頻繁にリリースされています。セルフホストで運用する以上、定期的なアップデートは欠かせません。

Docker Composeで運用するなら、アップデート前のバックアップ取得・コンテナの再構築手順をあらかじめ整えておきましょう。XServer VPSのワンクリックインストールを使う場合も、Dify本体のアップデートはユーザー側で実施する前提になります。

業務データの取り扱いはホスティング先次第

クラウド版とセルフホスト版では、会話ログやナレッジデータがどこに保管されるかが変わります。

機密情報や個人情報を扱うなら、社内のセキュリティポリシー・契約条件と整合するかを必ず確認したうえで、クラウド版を使うかセルフホスト版にするかを決めましょう。

「とりあえずクラウド版で機密データを試す」は事故のもとになりがちなので、最初の段階で線引きしておくのがおすすめです。

Difyを最短で動かすならXServer VPSのアプリイメージがおすすめ

Difyをセルフホストしたい方にとって、いまもっとも手軽なのがXServer VPSのDifyアプリイメージです。

アプリイメージ(テンプレート機能のようなもの)を活用することで、Difyのインストール・SSL証明書設定・自動起動までが一気通貫で済むようになっています。

「DockerやLinuxの設定は最低限にしたいけれど、自分のサーバーでDifyを動かしたい」という方の最短ルートです。

\ Difyのアプリイメージあり!/

XServer VPS × Difyの主な特徴

- VPS契約と同時にDifyをクリックでインストール可能

- Dify利用時のSSL証明書が無料

- VPS起動と同時にDifyが自動で稼働

- 独自ドメインまたはXServerサブドメインで公開できる

推奨プランと通常料金の目安

XServer VPSのDify特設ページによれば、Difyのアプリイメージはメモリ6GB以上のプランから利用できます。

Dify用に選ばれることが多いプランの通常料金は以下のとおりです。

| プラン | メモリ | vCPU | SSD | 通常月額 | 主な用途 |

|---|---|---|---|---|---|

| 6GBプラン | 6GB | 4コア | 150GB | 1,700円〜 | 個人のDify検証・小規模本番運用 |

| 12GBプラン | 12GB | 6コア | 400GB | 3,201円〜 | Dify+WordPress同居、複数LLM併用 |

| 24GBプラン | 24GB | 8コア | 800GB | 7,200円〜 | 本番運用・トラフィック多めのSaaS連携 |

個人開発・副業エンジニアのDify検証から始めるなら、まず6GBプランで十分です。社内で複数チームに展開する想定なら、12GB以上を最初から選ぶと拡張時に楽になります。

セットアップの大まかな流れ

XServer VPSでDifyを使い始めるまでの流れは、以下のとおりシンプルです。

- XServer VPSに申し込み、Difyのアプリイメージを選択

- コントロールパネルからDifyをインストール

- 独自ドメインまたはXServerサブドメインを割り当て、無料SSLを設定

- ブラウザでDifyにアクセスし、初期セットアップ後にAIアプリを構築

Docker(アプリを動かすための土台ソフト)の操作やリバースプロキシ設定、SSL証明書の更新スクリプトを書く必要はありません。「VPSは触ったことがあるけれど、Difyのインフラ構築にあまり時間を使いたくない」方には、ちょうど良い落としどころです。

Docker Composeでより細かく構成を制御したい場合の手順も公式マニュアルで提供されているので、慣れてきたら段階的に乗り換えることもできます。

\ Difyインストールに対応 /

Difyに関するよくある質問

Difyは無料で使えますか?

クラウド版(Dify Cloud)には無料のSandboxプランがあり、サインアップだけで試用クレジット内でアプリ構築を試せます。

本格利用にはProfessional以上の有料プランが必要です。セルフホスト版はオープンソース公開されているため、サーバー代と利用するLLMのAPI料金だけで運用できます。

Difyは商用利用できますか?

セルフホスト版・クラウド版ともに商用利用は可能です。ただし、Difyのオープンソースライセンスには「マルチテナントSaaSとして他社にDifyそのものを再販する」場合などに制限があります。

自社サービスにDifyで作ったAIアプリを組み込む通常の使い方であれば問題ありませんが、Dify自体を再販する形のビジネスを想定している場合は、最新のライセンス条項を必ず確認してください。

プログラミング知識がなくてもDifyを使えますか?

基本的なチャットボットやテキスト処理ツールなら、ノーコードで構築可能です。テンプレートをコピーして、プロンプトとナレッジを差し替えるだけで形になります。

一方で、外部APIとの細かな連携やカスタムプラグインの開発になるとプログラミング知識が必要です。「ノーコードで7割、ローコードで3割」というイメージで考えると現実的です。

DifyとChatGPTはどちらを使えばいいですか?

個人で雑談・調べもの・文章作成に使うだけなら、ChatGPT単体で十分です。

業務で複数のAIアプリを社内に展開したい、社内データをRAGで参照させたい、複数のLLMを使い分けたい、といった「組織で使う前提」になるとDifyの強みが効いてきます。両者は競合というより、用途で使い分ける関係です。

DifyをセルフホストするのにGPUは必須ですか?

OpenAIやClaudeなどの外部LLMをAPI経由で使う構成なら、GPUは不要です。一般的なVPS(vCPU 4コア・メモリ6GB程度)で十分動かせます。

ローカルLLM(Llamaなど)を自前で動かす場合に限り、GPU搭載のサーバーが必要になります。多くの個人・中小規模ユースケースでは、外部LLM APIと組み合わせるシンプルな構成で問題ありません。

XServer VPSと自前のサーバー、どちらでDifyを動かす方がいいですか?

Linuxサーバーの構築・保守に時間を割きたくないなら、XServer VPSのDifyアプリイメージのインストールが手早いです。

逆に、自社で物理サーバーや既存のクラウドVPC(AWS/GCPなど)を運用しているなら、そこにDocker ComposeでDifyを載せる方が、既存のインフラ管理ノウハウを活かせます。「インフラに何時間使えるか」で判断するのがおすすめです。

Difyで何ができるかのまとめ

Difyで何ができるかを、機能・事例・他ツールとの違いの観点から整理しました。

結論として、Difyは「LLMをノーコードで束ね、社内ナレッジ・ワークフロー・AIエージェントを画面で組み立てるための基盤」です。チャットボット・RAG・業務自動化・テキスト処理ツールまで、現場で必要とされるAIアプリの大半をカバーできます。

一方で、LLMモデル自体の精度を超える出力や、独自モデルのファインチューニング、ミリ秒単位のリアルタイム処理には向かない点も押さえておきましょう。ChatGPTやn8n、LangChainとは競合ではなく役割分担と捉え、用途で使い分けるのが現実的です。

これから本格的にDifyを試したい方は、まずクラウド版で感触をつかみ、業務利用に踏み込む段階でVPSセルフホストに移行するのが王道です。VPSセルフホストの最短ルートとしては、XServer VPSのDifyアプリイメージ機能を使うインストール方法が、初期構築の手間を最小化できる選択肢になります。

\ Dify対応・SSL無料・自動起動 /